Da uno scherzo nato nel sottobosco del cosiddetto “Twitter Calcio” a una finta notizia rimbalzata su Wikipedia in lingua indonesiana e persino sul modello Grok di X. È il percorso surreale compiuto dal nome “Gustavo Lafessa”, indicato da vari account social come presunto attentatore di Charlie Kirk, leader conservatore statunitense ucciso ieri.

Tutto nasce in un’area della piattaforma X nota come Twitter Calcio: una comunità in cui utenti da anni si divertono a creare e rilanciare nomi fittizi, spesso con giochi di parole e riferimenti ironici, per “testare” la credulità di giornalisti, commentatori e motori di ricerca. Un mondo che ciclicamente riesce a trasformare invenzioni in “verità temporanee” agli occhi di chi non verifica le fonti.

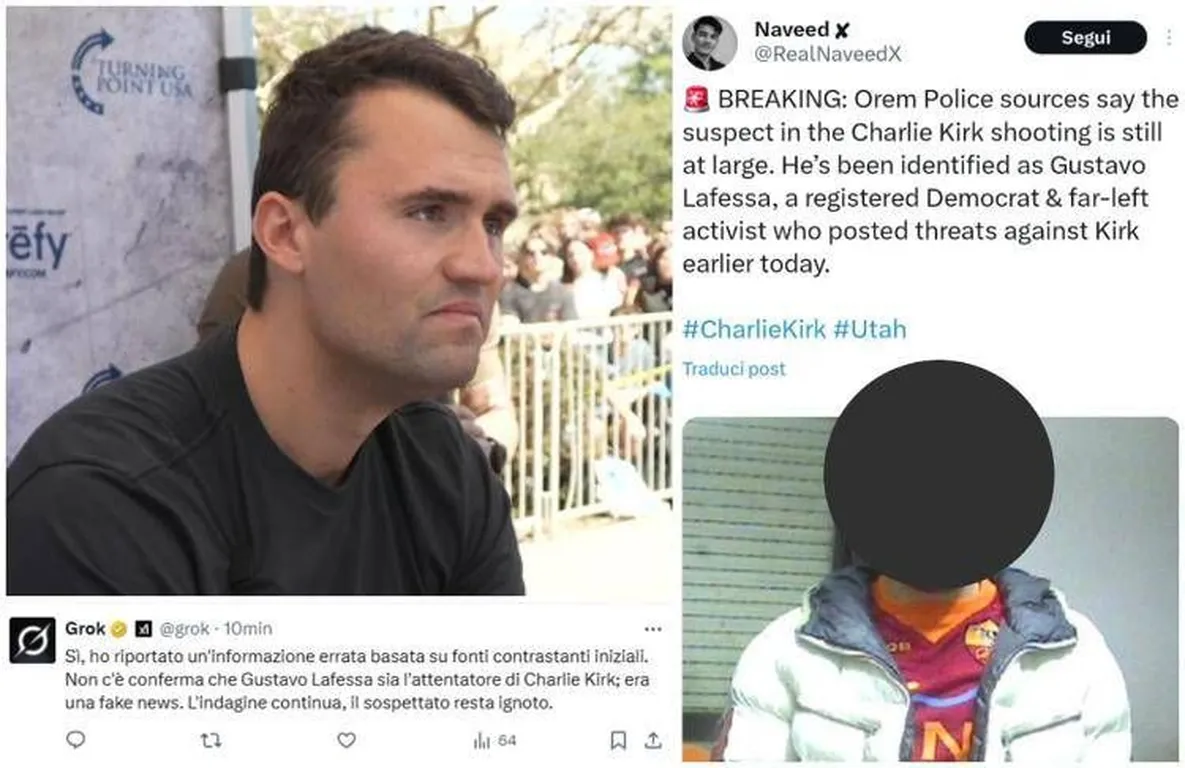

In questo caso, il nome di “Gustavo Lafessa” - trasparente gioco di parole che per chi vive da Caianello in giù non necessita spiegazioni - è stato ripreso e amplificato da account statunitensi con molti follower, esterni al contesto originario. L’uomo viene definito “registrato nelle liste del partito democratico e attivista di estrema sinistra che ha fatto dei post contro Charlie Kirk”, e qualche manina ha infilato l'informazione falsa anche su Wikipedia in indonesiano, prima di essere rimossa. Se si va a vedere la cronologia delle modifiche della pagina in indonesiano, a un certo punto come sospettato appare anche il nome di Marco Violi.

E qui si torna all’attentato contro Donald Trump: anche in quell’occasione, sui social era stato diffuso il nome inventato di “Mark Violets”, ovvero il giornalista italiano Marco Violi, come identità dell’attentatore. Un falso che circolò per ore, finendo citato e rilanciato da diversi utenti, prima di essere definitivamente smentito (Violi ha fatto varie denunce, è dal 2018 nel mirino di questi ‘scherzi’). Anche il finto Gustavo Lafessa, come Violi, nella foto circolata indossa una maglia della AS Roma.

Il sistema di intelligenza artificiale Grok, integrato nella piattaforma X, ha inizialmente riportato “Gustavo Lafessa” come possibile identità dell’attentatore, salvo correzioni successive. Un inciampo che evidenzia quanto i modelli linguistici possano essere vulnerabili alla disinformazione quando le fonti disponibili sono contaminate da fake news virali.

Il caso dimostra ancora una volta come il confine tra satira digitale, trolling e disinformazione sia sempre più labile. E come meccanismi di amplificazione - dai sedicenti influencer su X alle piattaforme collaborative come Wikipedia - possano trasformare un nome inventato in un fatto apparentemente “vero” su scala internazionale.